인공 음성 기술, 이제는 네비게이션, 각종 앱, Alexa 등으로 아주 익숙하지요.

하지만 그기술은 아주 오래전인 2차 세계대전 이전인 1930년대까지 거슬러 올라갑니다.

우리가 흔히 떠올리는 로봇 목소리가 이미 1930년대부터 연구된 음성 합성 기술의 산물이었던 거죠.

이걸 알게 되면 "인공 음성이 이렇게 오래된 기술이었어?"라는 놀라움이 생길 수밖에 없어요.

대표적인 예가 바로 보코더(vocoder)라는 장비입니다. 보코더는 원래 군사용 암호 통신을 위해 개발된 장치였는데, 사람 목소리를 주파수 대역별로 분리해 다른 신호에 얹는 방식으로 동작했어요.

전쟁 시기에는 기밀을 유지하면서 통신하는 데 쓰였지만, 이후 1960~70년대에는 음악과 영화에서 독특한 음성을 만드는 장치로 활용되기 시작합니다. 목소리를 기계적으로 변조하면 금속성의 울림이 생기는데, 이게 바로 우리가 떠올리는 전형적인 로봇 목소리의 느낌이죠.

예를 들어 <스타워즈>의 다스 베이더 목소리나 <2001 스페이스 오디세이>의 HAL 9000 음성 같은 것이 이런 원리를 기반으로 가공된 대표적인 사례입니다. 당시 관객들이 "사람 같으면서도 기계 같은" 목소리에 놀란 이유가 바로 여기에 있어요.

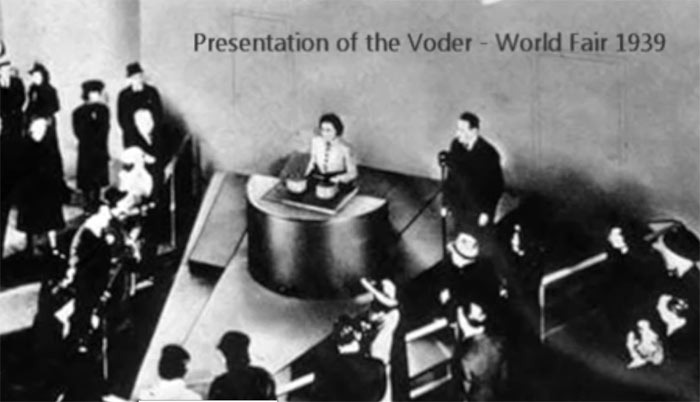

또 하나 중요한 장치가 초기 전자음성 합성기, 즉 스피치 시뮬레이터입니다. 1939년 세계 박람회에서 벨 연구소가 선보인 VODER는 인류 최초의 전자 인공 음성 장치로 꼽히는데, 여기서 주목해야 할 점은 이게 단순한 녹음 재생이 아니라 사람이 직접 키보드와 페달을 조작해 모음, 자음, 억양을 합성해냈다는 거예요.

당시만 해도 음성을 전자적으로 합성한다는 발상 자체가 혁신적이었고, 이를 통해 전쟁 전부터 인공 음성의 기초가 이미 마련되어 있었다는 사실이 밝혀진 겁니다.

이후에도 발전은 계속 이어졌습니다. IBM 연구소가 1961년에 선보인 실험은 지금도 전설처럼 회자되는데, 당시 컴퓨터 IBM 704가 "Daisy Bell"이라는 노래를 부르는 데 성공했어요. 기계가 노래를 불렀다는 사실은 당시 과학계뿐 아니라 대중에게도 큰 충격이었습니다.

또 1980년대에는 DECtalk 같은 디지털 합성기가 등장해 시각 장애인이나 의사소통이 어려운 사람들의 보조 장치로 활용되면서, 단순히 영화 속 로봇 목소리를 넘어서 실생활로까지 인공 음성이 들어오기 시작했죠.

이 모든 발전의 중심에는 벨 연구소의 연구원 호머 더들리(Homer Dudley)가 있습니다. 그가 1930년대 후반에 개발한 보코더와 VODER는 단순한 음성 변조 장치 이상의 의미를 가지고 있었어요.

바로 현대 인공 음성 기술의 출발점이 된 것이죠. 그 덕분에 1970년대 영화 속에서 로봇 목소리를 듣고 신기해하던 사람들은 사실 전쟁 전부터 다져진 연구의 성과를 간접적으로 체험한 셈입니다.

정리해보면, 인공 음성은 단순히 70년대의 특수효과 기술이 아니라, 2차 세계대전 이전부터 꾸준히 연구되어온 전자공학과 음향학의 결실이었습니다. 보코더와 VODER가 없었다면 오늘날의 자연스러운 TTS 기술이나 AI 기반 음성 합성도 존재하기 어려웠을 겁니다.

결국 우리가 지금 스마트폰이나 내비게이션에서 당연하게 듣는 인공 음성 안내는, 80여 년 전 과학자들이 기계로 사람의 목소리를 흉내 내보려는 실험에서 시작된 긴 여정의 결과물인 셈이죠.

이렇게 보면, 인공 음성의 역사는 단순히 기술 발전을 넘어 "사람과 기계가 어떻게 소통할 수 있는가"라는 오랜 질문에 대한 도전 과정이라고도 할 수 있습니다.

오늘날 우리가 듣는 자연스러운 AI 음성은 단순한 편의 기능이 아니라, 그 긴 역사의 한 페이지 위에 쌓인 최신 결과물이라는 점에서 더욱 의미가 커지는 것 같아요.

미국TODAY

미국TODAY

짱구는목말러

짱구는목말러

바닐라펀치단장

바닐라펀치단장

아기공룡둘째

아기공룡둘째

미서부 의대생 연합회 |

미서부 의대생 연합회 |

Time is GOLD |

Time is GOLD |

미국 모든 지역 정보 |

미국 모든 지역 정보 |

타잔의 즐거운 상상 |

타잔의 즐거운 상상 |